Tutti parlano di Intelligenza Artificiale e in questi ultimi mesi la ricerca su Google dell’acronimo AI è cresciuta in modo esponenziale. A che punto è la regolamentazione in Italia e nel Mondo?

Un tema delicato perché quando si disciplina e si regolamenta l’uso delle nuove tecnologie bisogna trovare il giusto rapporto e mix, tra norme e progresso. Le norme non devono essere di ostacolo al progresso e il progresso non deve temere le regole.

Sappiamo che l’Intelligenza Artificiale rappresenta la rivoluzione industriale del nostro tempo, destinata a cambiare completamente la nostra vita. Si parla di un nuovo rinascimento tecnologico. Il suo sviluppo e la sua applicazione nella società è molto più veloce rispetto a quanto siano capaci i Paesi di definirne una disciplina.

Un gap atavico, che per la verità non è così nuovo, perché da sempre le innovazioni arrivano prima del diritto. Il diritto non riesce mai a seguire di pari passo lo sviluppo delle nuove tecnologie. E forse è anche giusto sia così. E anche per l’intelligenza artificiale, non solo in Europa ma in tutto il mondo, la disciplina giuridica è in ritardo.

C’è chi scherzando sostiene che le uniche leggi attualmente esistenti siano ancora soltanto quelle immaginate da Isaac Asimov negli anni quaranta nei suoi visionari romanzi sulla robotica! E - scherzi a parte - quelle leggi immaginarie non sono poi così distanti dai binari sui quali si stanno incanalando i giuristi di tutto il mondo.

In Europa, è di pochi giorni fa il via libera delle commissioni Giustizia e Mercato Interno dell’Eurocamera all’AI ACT.

Rappresenta il primo passo verso una legge sull’Intelligenza Artificiale il cui compito è tracciare un quadro normativo che tuteli i diritti senza bloccare l’innovazione, assicurando che i sistemi di IA presenti sul mercato dell’Unione siano sicuri e rispettino la normativa vigente in materia di diritti fondamentali e di valori dell’UE.

Per conseguire questi obiettivi la proposta legislativa in itinere ha un approccio normativo equilibrato e proporzionato, si limita a disciplinare i requisiti minimi necessari per affrontare i rischi e i problemi collegati, senza limitare od ostacolare lo sviluppo tecnologico o aumentare in modo sproporzionato il costo dell’immissione sul mercato di soluzioni di IA.

La norma si prefigge di definire un quadro giuridico solido per affrontare le esigenze future e le scelte normative fondamentali, compresi i requisiti basati sui principi che i sistemi di IA dovrebbero soddisfare. Dall’altro, mette in atto un sistema normativo incentrato su un approccio basato sul rischio, che non crea restrizioni inutili al commercio. Allo stesso tempo, il quadro giuridico comprende meccanismi flessibili per far sì che possa essere adeguato dinamicamente all’evoluzione della tecnologia e all’emergere di nuove situazioni di preoccupazione.

Quanto è stato sottoscritto dall’Europarlamento fissa, quindi:

- regole per lo sviluppo;

- regole l’immissione sul mercato;

- Regole per l’utilizzo di sistemi di IA nell’Unione seguendo un approccio proporzionato basato sul rischio.

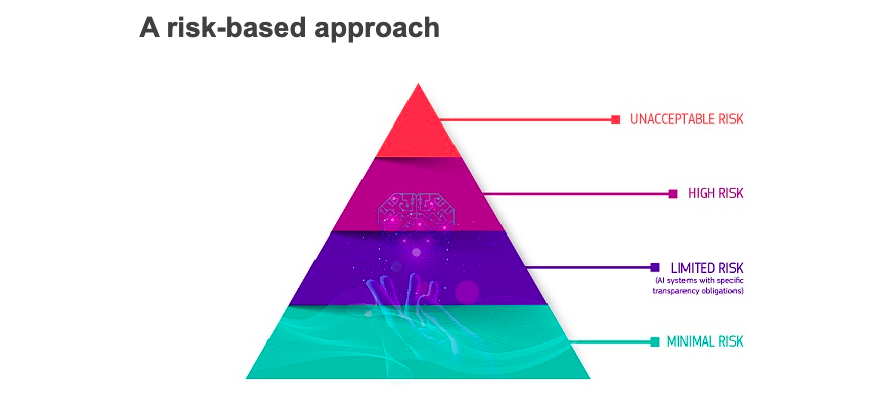

La proposta, inoltre, si basa sulla gestione del rischio, definendo 4 categorie definite in:

- minimo;

- limitato;

- alto;

- inaccettabile.

Stabilisce una solida metodologia per la gestione del rischio definito elevato e una serie di requisiti, obblighi e divieti per le gestione dei sistemi considerati a rischio alto, ovvero che pongono rischi significativi per la salute e la sicurezza o che impattano sui diritti fondamentali delle persone.

Alcune pratiche di AI particolarmente dannose sono vietate in quanto considerate in contrasto con i valori dell’Unione. Sono proposte restrizioni e tutele specifiche in relazione a determinati usi dei sistemi di identificazione biometrica remota.

Obblighi, proporzionati e chiari, sono previsti anche per i fornitori e per gli utilizzatori di tali sistemi con l’obiettivo di assicurare la sicurezza durante l’intero ciclo di vita dei sistemi di AI.

Le regole proposte dalla normativa saranno applicate attraverso un sistema di governance centralizzata, con l’istituzione di un Comitato Europeo per l’Intelligenza Artificiale.

Si attende il voto in plenaria, previsto tra il 12 e il 15 giugno, per dare avvio poi alla fase dei negoziati inter-istituzionali con il Consiglio dell’Ue. L’obiettivo è portare a compimento il progetto entro la primavera del 2024.

Ma il dibattito giuridico sull’Intelligenza Artificiale va molto oltre il testo messo a punto dall’Europa.

Ci si interroga su dove l’AI potrà arrivare, su quanto queste macchine potranno diventare sempre più intelligenti e autonome e, quindi, se le norme attuali saranno sufficienti a prevenire e gestire tutti i possibili danni arrecati da queste entità intelligenti diverse dall’uomo.

Il dibattito oltre a coinvolgere gli aspetti giuridici e puramente tecnici coinvolge naturalmente anche gli aspetti etici.

E c’è chi, addirittura, già ipotizza una personalità elettronica. Ma questa è un’altra storia e l’affronteremo nel prossimo articolo!

© RIPRODUZIONE RISERVATA